A climatização de Data Centers é um dos assuntos mais complexos deste ambiente e junto com a energia elétrica formam, talvez, a dupla mais crítica de qualquer Data Center. Abordando, especialmente, o sistema de refrigeração, podemos apontar diversos aspectos que devem ser levados em consideração para o melhor aproveitamento do sistema, o qual existe para manter a operação confiável da carga crítica, ou seja, dos equipamentos e sistemas de TI.

Como todo e bom assunto técnico, deve-se ter o cuidado em se buscar referências de normas e melhores práticas pertinentes para se chegar à melhor solução possível. Entretanto, sabemos que uma boa relação custo x benefício sempre é considerada nas decisões de cada projeto. Aqui vamos nos ater aos requisitos técnicos da climatização, deixando a análise financeira para outro momento.

Começamos pelas orientações da ASHRAE (American Society of Heating, Refrigerating and Air-Conditioning Engineers), uma associação de engenheiros voltada para sistemas de refrigeração e muito respeitada em todo o mundo. Ela serve de base para orientar projetos de climatização de Data Centers, com requisitos de temperatura e umidade muito rigorosos. Além da preocupação com o melhor funcionamento dos equipamentos, outro aspecto sob controle é a eficiência energética da instalação.

A Sala de Computadores (ou Servidores) de um Data Center não deve ser climatizada utilizando-se de equipamentos compartilhados com outras áreas da edificação como um todo, isto é, deve haver independência da climatização de outros departamentos e mantido 24x7x365 enquanto a carga crítica estiver em funcionamento. Para se garantir este trabalho ininterrupto o sistema deve ser alimentado, ou garantido, por um contingenciamento de energia. Deverá ser previsto, portanto, um grupo motor-gerador que assuma este fornecimento em caso de falhas na entrega de energia por parte da Concessionária local (pontos de vista diferentes sobre este aspecto podem surgir quando o DC for classificado em Tiers – mas, isto é assunto para outro artigo).

Equipamentos de TI precisam de refrigeração para que o seu processamento interno não seja o responsável pelo seu mau funcionamento ou desligamento, uma vez que são fonte de calor. As ventoinhas internas fazem o trabalho de expulsar o ar quente interno dos equipamentos, porém precisam de ajuda, e esta vem através do ar refrigerado que entra, na maioria das vezes, pela parte frontal dos racks. Desta forma, o ar frio que entra pela frente do rack deve sair por trás do mesmo, mas para que isto ocorra, um caminho forçado deve ser criado para garantir a refrigeração, do contrário, o ar frio destinado ao equipamento pode não ser aproveitado se transformando em ar quente, consequentemente, em perdas energéticas, sem falar no aquecimento do(s) equipamento(s).

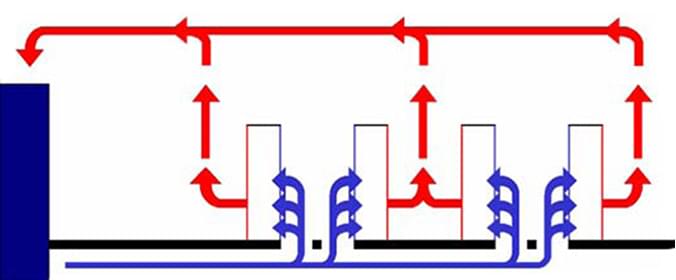

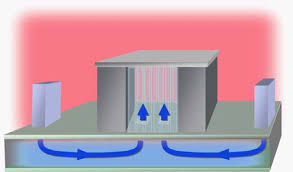

Para se obter melhor eficiência da climatização em um Data Center, o controle dos fluxos de ar frio e quente deve ser criterioso, de forma que a mistura dos dois seja evitada ao máximo. Para que o fluxo de ar seja melhor utilizado trazendo eficiência ao sistema, o uso de corredores frio / quente é uma boa opção, confinando o ar frio, ou o ar quente, buscando um isolamento total entre a área fria da área quente.

Algumas sugestões para melhorar a eficiência, ou o aproveitamento do ar, em seu Data Center:

- Providencie a vedação das saídas de cabos e dutos em pisos elevados (figura 1).

- Observe se as placas de piso elevado não possuem frestas (figura 2).

- As saídas de ar frio, através de placas perfuradas, devem estar apenas nos corredores frios (figura 3).

- Utilizar painéis cegos nas unidades sem uso do rack, isso dará curso ao fluxo de ar.

- Criar um sistema de confinamento do ar quente ou frio (a figura 4 mostra o confinamento do ar frio, representado pela cor azul e o ar quente pelo vermelho).

Figura 1

Figura 2

Figura 3

Figura 4

Como mostrado na figura 4, o confinamento é um método bastante eficiente para separar o ar quente do ar frio, evitando-se o desvio do ar frio, chamado de “by-pass” e, também, diminuindo a recirculação do ar quente. O by-pass é quando o ar frio é desviado e não chega ao seu destino, ou seja, aos equipamentos de TI. A recirculação é quando o ar quente que sai por trás do equipamento volta pela frente do mesmo, logo, criando um loop de ar quente pelo equipamento.

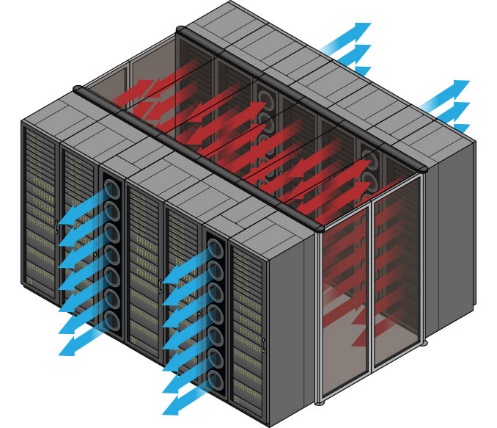

Há outras técnicas de confinamento como o In-row (figura 5) e o uso de racks com chaminé (figura 6), sendo este último bastante interessante. Trata-se de racks especiais que direcionam o ar quente a um forro chamado de “plenum”, onde este é o caminho de retorno do ar quente e dispensa o uso de piso elevado. Já o In-row são equipamentos instalados entre racks para criar o confinamento de ar quente.

Figura 5

Figura 6

Com estas poucas medidas executadas corretamente, já há ganhos significativos como a redução da velocidade das ventoinhas dos equipamentos, isso gera eficiência consumindo menos energia. E, ainda, pode-se aumentar a temperatura do ar frio, o que força menos os equipamentos de climatização economizando energia também.

Existem dois tipos básicos de refrigeração: de conforto e de precisão. O sistema de refrigeração de conforto deve trazer bons resultados para o calor latente, aquele que é gerado pelas pessoas, funcionando, em geral, 8h/dia. Estes equipamentos não são projetados para longas jornadas ininterruptas, diferentemente dos equipamentos de precisão. Estes têm capacidade para operar continuamente e grande capacidade para o calor sensível, aquele gerado por máquinas, insuflando enorme quantidade de ar por metro cúbico. Sistemas de precisão devem possuir controle automático de temperatura e umidade para garantir a precisão desejada.

Estes poucos parágrafos são apenas uma pincelada neste mundo vasto e rico em tecnologia e engenharia, que demanda muito estudo e profissionais altamente capacitados. Quando falamos em Data Centers não nos referimos à simples Salas de Telecomunicações com dois / três racks, pois o volume de informações, concentração de equipamentos, e o custo por minuto de um DC é imensamente maior. Basta pensar no Data Center de uma operadora de cartão de crédito ou banco, por exemplo, dá para ver a grandiosidade deste ambiente e os prejuízos se paradas inesperadas acontecerem.

Reinaldo Vignoli – Engenheiro Eletricista, formado pela PUC/MG, possui MBA em Gerenciamento de Projetos, especialista em Projetos de Infraestrutura Física de Redes e Professor Universitário.